各位同学是否在使用DeepSeek中经常遇到服务器繁忙的情况?或者是一直在显示思考中,下面三分钟教会你如何在自己的电脑上部署DeepSeek。

第一步:下载Ollama

网址:https://ollama.com/

首先,我们需要用到的是Ollama这款软件。这是一个免费开源的本地大语言模型运行平台,可以帮你把deepseek模型下载到你的电脑并运行。

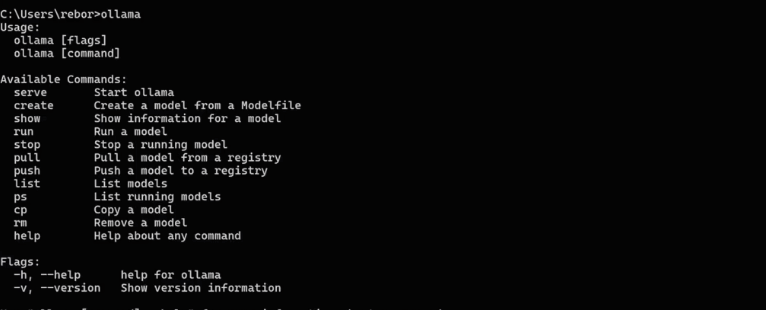

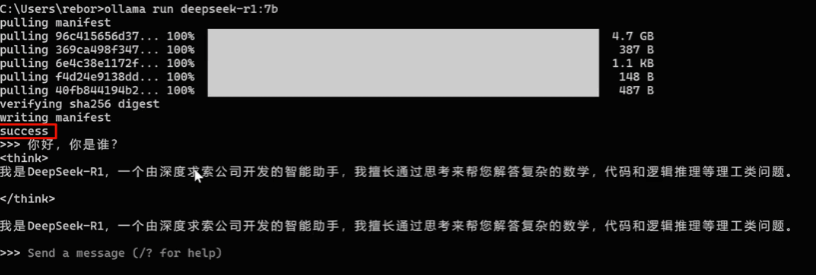

下载后傻瓜式安装完成后,在电脑中搜索cmd,打开后输入ollama并回车,如果看到的是这样的输出,就说明你已经安装成功了。

如果提示你找不到该命令,可以检查一下你系统的环境变量有没有配置Ollama的安装目录,如果已经有该配置,但还是提示你找不到该命令的话,那么就使用一下万能方法,重启一下电脑。

第二步:下载Deepseek模型

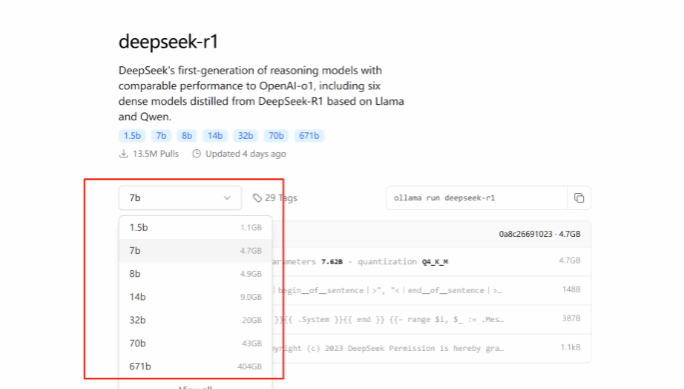

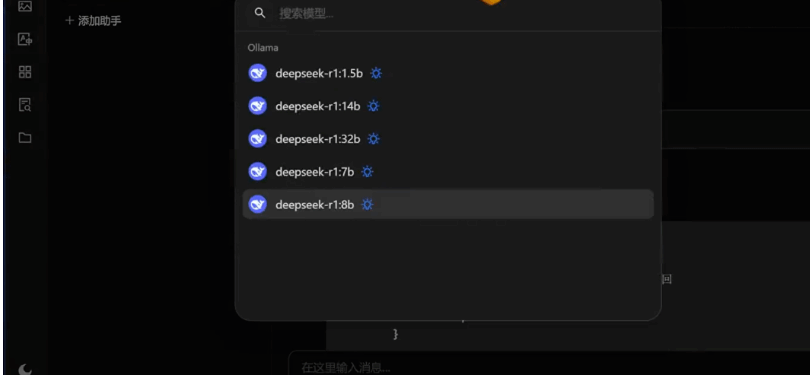

我们到Ollama官网首页,点击这里的deepseek-r1,会进入到deepseek模型的下载主页,deepseek-r1目前主要有1.5b、7b、8b、14b、32b、70b、671b,这几种不同量级的开源模型。

数字后面的b是英文billion,也就是十亿的首字母,整体代表的是模型的参数量,1.5b就是15亿参数,7b就是70亿参数,参数量越大意味着你得到的回答的质量也就越高。但是参数量越大,所需要的GPU资源也就越高,如果你的电脑没有独立显卡,那么就选择1.5b版本。

如果有独立显卡,但显存是4G或8G左右的,可以选择7b或8b的版本。 确定好模型版本之后,只需要把对应命令粘贴到cmd终端回车,等待模型下载完成,然后自动运行就好了。

当你看到这个success的提示时,至此,deepseek本地版就部署好了。但现在只能在终端使用这种命令行式的方式进行对话,体验不太好。所以我们需要借助一些第三方工具,实现官网中的对话样式。

第三步:下载第三方UI客户端

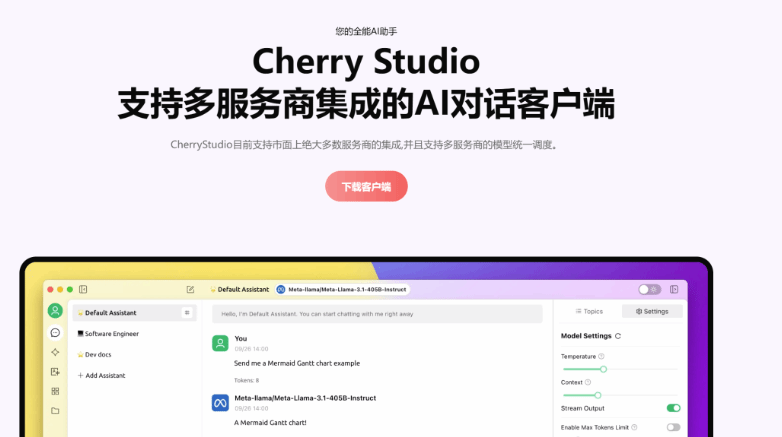

网址:https://cherry-ai.com/

这里推荐大家使用Cherry Studio这款工具。它是一个支持多家大模型平台的AI客户端,它可以直接对接ollama API,实现窗口式的大模型对话效果。

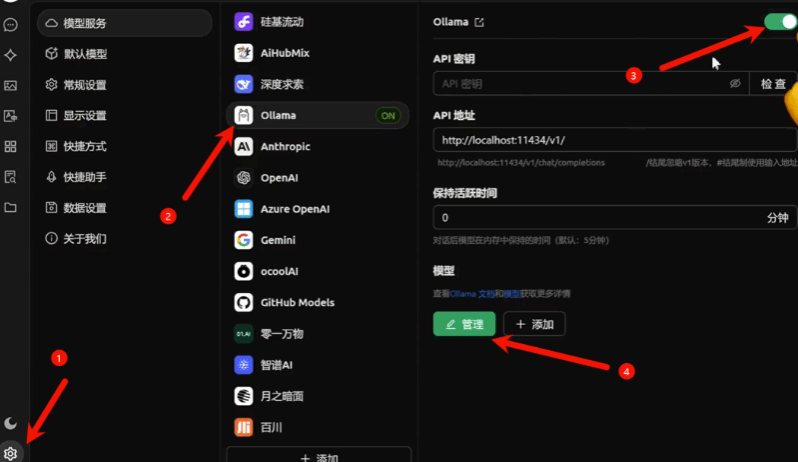

首先,到官网下载软件,安装完成后,点击左下角的设置。在模型服务中选择ollama。首先把顶部的开关打开,然后点击底部的管理按钮。

在弹出的界面中添加你刚才下载的deepseek模型。然后回到首页的对话界面,这时就可以和deepseek进行对话了。如果你安装了多个deepseek模型,也可以点击顶部进行切换。

最后,对于我们学生个人使用来说,8b或32b的版本其实已经完全够用了,特别是在断网的情况下,它依然可以正常工作,而且不会出现服务器繁忙的情况。这一点是在线版本无法比拟的。